Denne artikkelen vil diskutere noen av måtene å gjennomsøke et nettsted, inkludert verktøy for nettgjennomgang og hvordan du bruker disse verktøyene til forskjellige funksjoner. Verktøyene diskutert i denne artikkelen inkluderer:

- HTTrack

- Cyotek WebCopy

- Content Grabber

- ParseHub

- OutWit Hub

HTTrack

HTTrack er en gratis programvare med åpen kildekode som brukes til å laste ned data fra nettsteder på internett. Det er en brukervennlig programvare utviklet av Xavier Roche. De nedlastede dataene lagres på localhost i samme struktur som på det opprinnelige nettstedet. Fremgangsmåten for å bruke dette verktøyet er som følger:

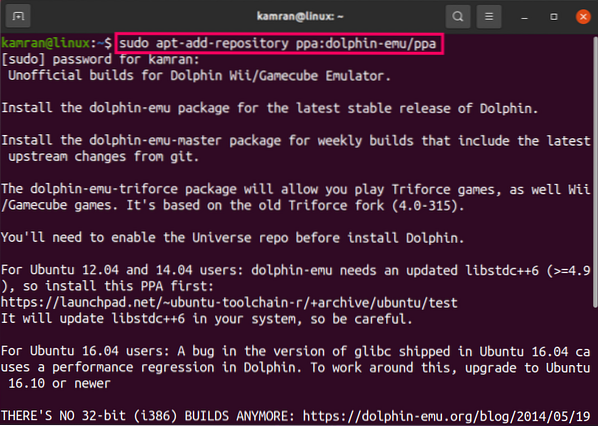

Først installerer du HTTrack på maskinen din ved å kjøre følgende kommando:

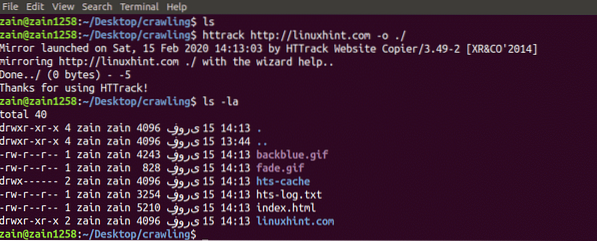

[e-postbeskyttet]: ~ $ sudo apt-get install httrackEtter å ha installert programvaren, kjør følgende kommando for å gjennomsøke nettstedet. I det følgende eksemplet vil vi krype linuxhint.com:

[e-postbeskyttet]: ~ $ httrack http: // www.linuxhint.com -o ./Ovennevnte kommando vil hente alle dataene fra nettstedet og lagre dem i gjeldende katalog. Følgende bilde beskriver hvordan du bruker httrack:

Fra figuren kan vi se at dataene fra nettstedet er hentet og lagret i gjeldende katalog.

Cyotek WebCopy

Cyotek WebCopy er en gratis web-gjennomgangsprogramvare som brukes til å kopiere innhold fra et nettsted til localhost. Etter å ha kjørt programmet og gitt nettstedskoblingen og målmappen, vil hele nettstedet bli kopiert fra gitt URL og lagret i localhost. nedlasting Cyotek WebCopy fra følgende lenke:

https: // www.cyotek.no / cyotek-webkopi / nedlastinger

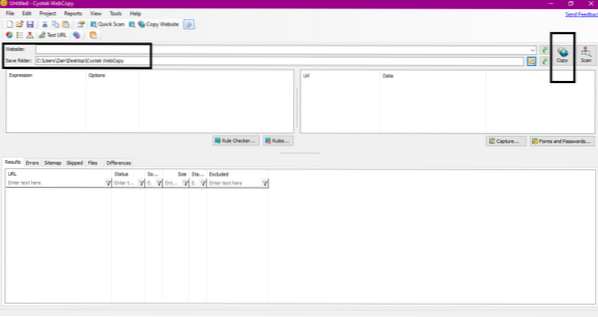

Etter installasjonen, når web-crawler kjøres, vises vinduet som er vist nedenfor:

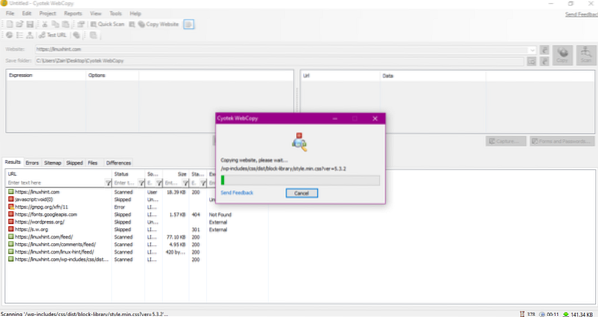

Når du skriver inn nettadressen til nettstedet og angir destinasjonsmappen i de nødvendige feltene, klikker du på kopi for å begynne å kopiere dataene fra nettstedet, som vist nedenfor:

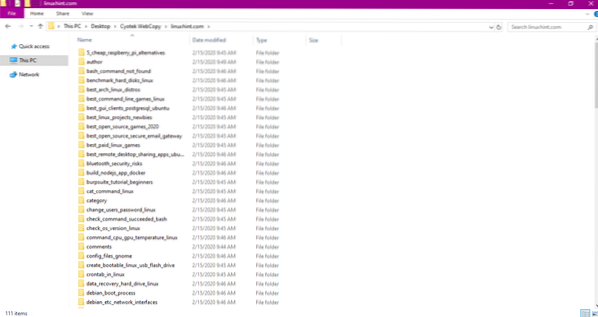

Etter at du har kopiert dataene fra nettstedet, må du kontrollere om dataene er kopiert til destinasjonskatalogen på følgende måte:

I bildet ovenfor er alle dataene fra nettstedet kopiert og lagret på målplasseringen.

Content Grabber

Content Grabber er et skybasert program som brukes til å trekke ut data fra et nettsted. Det kan trekke ut data fra ethvert nettsted med flere strukturer. Du kan laste ned Content Grabber fra følgende lenke

http: // www.tukuer.no / forhåndsvisning / 1601497 / Content-Grabber

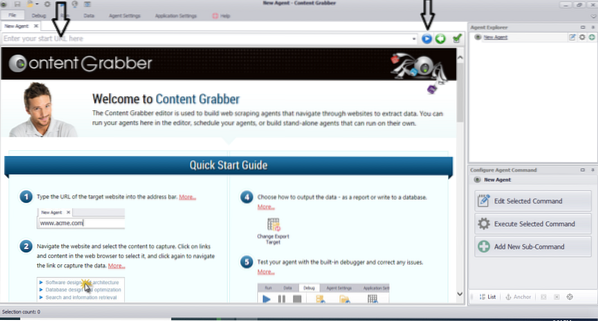

Etter å ha installert og kjørt programmet, vises et vindu, som vist i følgende figur:

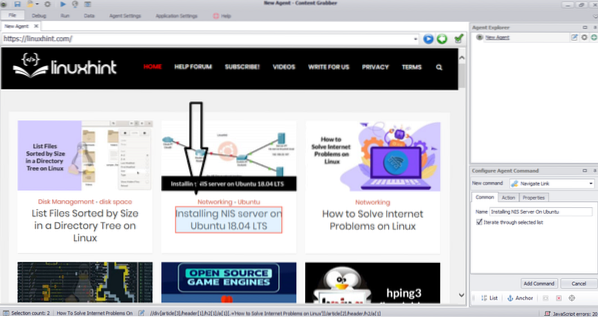

Skriv inn nettadressen til nettstedet du vil hente ut data fra. Når du har angitt nettadressen til nettstedet, velger du elementet du vil kopiere som vist nedenfor:

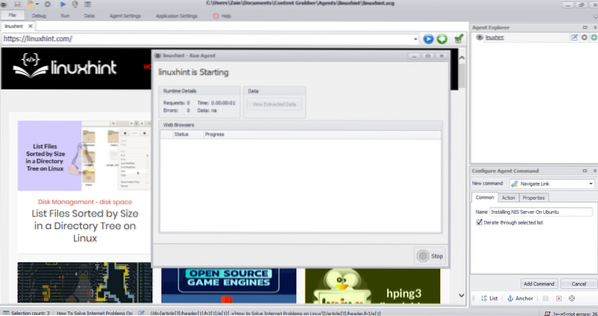

Etter å ha valgt ønsket element, begynn å kopiere data fra nettstedet. Dette skal se ut som følgende bilde:

Dataene hentet fra et nettsted lagres som standard på følgende sted:

C: \ Brukere \ brukernavn \ Dokument \ Innhold GrabberParseHub

ParseHub er et gratis og brukervennlig nettgjennomsøkingsverktøy. Dette programmet kan kopiere bilder, tekst og andre former for data fra et nettsted. Klikk på følgende lenke for å laste ned ParseHub:

https: // www.parsehub.com / hurtigstart

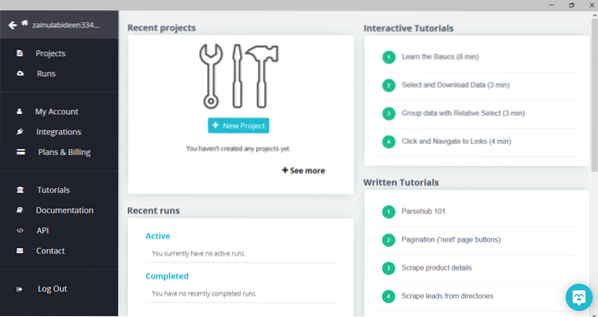

Etter nedlasting og installering av ParseHub, kjør programmet. Et vindu vises, som vist nedenfor:

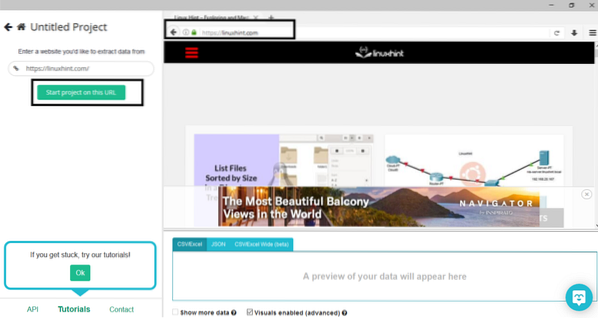

Klikk på "Nytt prosjekt", skriv inn URL-en i adressefeltet til nettstedet der du ønsker å hente ut data, og trykk enter. Klikk deretter på “Start Project on this URL.”

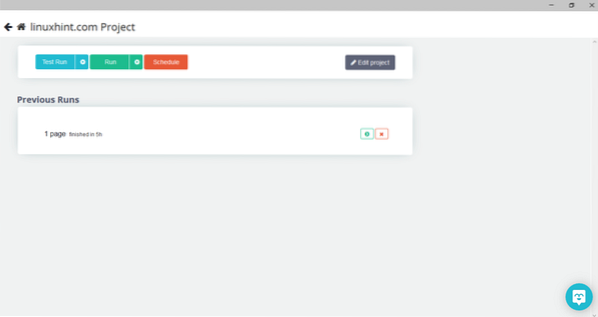

Når du har valgt ønsket side, klikker du på "Få data" på venstre side for å gjennomsøke websiden. Følgende vindu vises:

Klikk på "Kjør" og programmet vil be om datatypen du vil laste ned. Velg ønsket type, og programmet vil be om destinasjonsmappen. Til slutt lagrer du dataene i destinasjonskatalogen.

OutWit Hub

OutWit Hub er en web-crawler som brukes til å trekke ut data fra nettsteder. Dette programmet kan trekke ut bilder, lenker, kontakter, data og tekst fra et nettsted. De eneste nødvendige trinnene er å angi nettadressen til nettstedet og velge datatypen som skal trekkes ut. Last ned denne programvaren fra følgende lenke:

https: // www.overliste.no / produkter / hub /

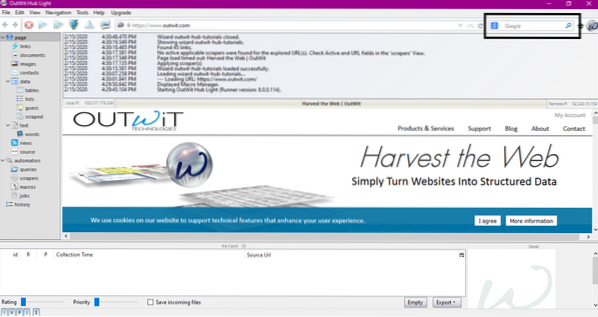

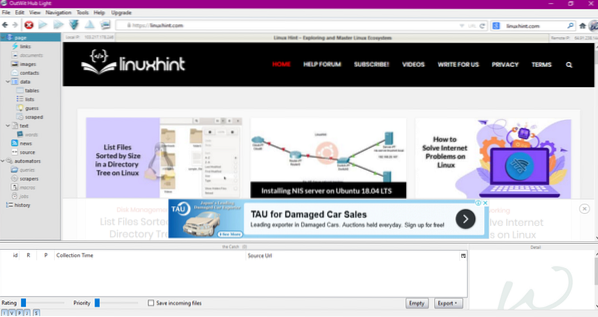

Etter å ha installert og kjørt programmet, vises følgende vindu:

Skriv inn nettadressen til nettstedet i feltet som vises i bildet ovenfor, og trykk enter. Vinduet viser nettstedet, som vist nedenfor:

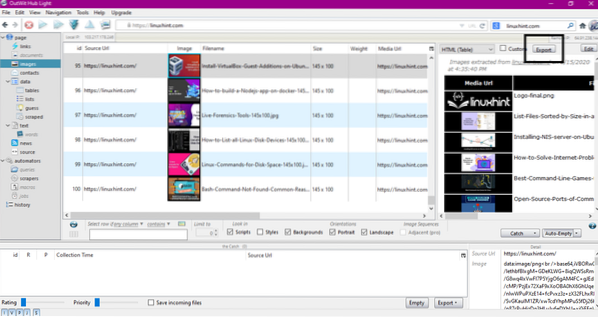

Velg datatypen du vil trekke ut fra nettstedet fra panelet til venstre. Følgende bilde illustrerer denne prosessen nøyaktig:

Nå velger du bildet du vil lagre på localhost og klikker på eksportknappen merket i bildet. Programmet vil be om destinasjonskatalogen og lagre dataene i katalogen.

Konklusjon

Web-crawlere brukes til å trekke ut data fra nettsteder. Denne artikkelen diskuterte noen nettgjennomsøkingsverktøy og hvordan du bruker dem. Bruken av hver web-crawler ble diskutert trinn for trinn med tall der det var nødvendig. Jeg håper at etter å ha lest denne artikkelen, vil du finne det enkelt å bruke disse verktøyene til å gjennomsøke et nettsted.

Phenquestions

Phenquestions