For selv om du holder deg til Long Term Support (LTS) -utgivelser, er Linux-distribusjoner ofte mer utsatt enn Windows-maskiner for å gå - plutselig og spektakulært - ute av drift.

Hvorfor, i så mange tilfeller, er dette slik??

- Maskinvarekompatibilitet, inkludert for viktige komponenter som GPUer, er fortsatt en betydelig utfordring med mange leverandører som fremdeles ikke støtter Linux-distribusjoner, og overlater det til samfunnet å lage løsninger;

- Åpen kildes økonomiske modell stimulerer ikke, langt mindre krever grundige QA-prosesser;

- Og for de som holder tritt med utgivelser fra blødende kanter, har grunnleggende endringer i verktøy for pakkehåndtering en stygg vane å noen ganger murere systemet ved å åpne en uopprettelig Pandoras eske med avhengighetsfeil. Å reparere disse, selv når det er mulig, kan innebære å gjøre ned dager lange kaninhull. Det som kan virke som en god læringsopplevelse for en førstegangsbruker, kan bli en avbrekkende frustrasjon for en veteranbruker på randen til å hoppe skipet til Windows.

Og Linuxs stabilitetsproblem har opprørt mange brukere. Bla gjennom mange bruker-i-nød tråder på AskUbuntu.com og du kommer over mange frustrerte plakater som har prøvd alt og til slutt har bestemt at den eneste veien videre er å installere fra bunnen av.

Mens du gjør dette, kan det i utgangspunktet være en slags læringsprosess, og oppfordre brukerne til periodisk å revurdere hvordan de kan gjøre systemet tynnere og effektivisere gjenopprettingsprosessen, etter en stund blir det ikke noe bedre enn en stor, tidskrenkende plage. Før eller senere vil selv de mest avanserte kraftbrukerne begynne å kreve stabilitet.

Jeg har brukt Linux som mitt daglige operativsystem i mer enn 10 år og har gått gjennom min del av uønskede, rene installasjoner. Så mange faktisk at jeg lovet at min siste reinstallasjon ville være min siste. Siden da har jeg utviklet følgende metodikk. Og det har fungert for å holde Lubuntu-systemet mitt like bra som den dagen jeg installerte det uten ominstallasjon siden. Her er hva jeg gjør.

Hensyn: Hva trenger du for å sikkerhetskopiere?

Før du bestemmer deg for en sikkerhetskopistrategi, må du finne ut noen grunnleggende:

- Hva trenger du for å sikkerhetskopiere? Trenger du å sikkerhetskopiere hele partisjonen / volumet eller bare hjemmebrukarkatalogen?

- Vil en trinnvis sikkerhetskopistrategi være tilstrekkelig for din brukstilfelle? Eller trenger du å ta full sikkerhetskopier?

- Må sikkerhetskopien krypteres?

- Hvor enkelt trenger du gjenopprettingsprosessen?

Backupsystemet mitt er basert på en blanding av metoder.

Jeg bruker Timeshift som mitt primære sikkerhetskopisystem, som tar inkrementelle øyeblikksbilder. Og jeg beholder en full sikkerhetskopi på stedet som ekskluderer kataloger som ikke inneholder brukerdata. I forhold til systemets rot er disse:

- / dev

- / proc

- / sys

- / tmp

- /løpe

- / mnt

- /media

- / tapt + funnet

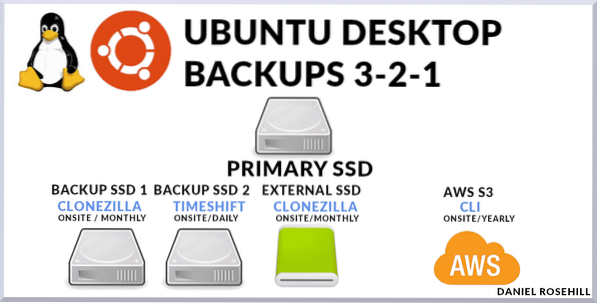

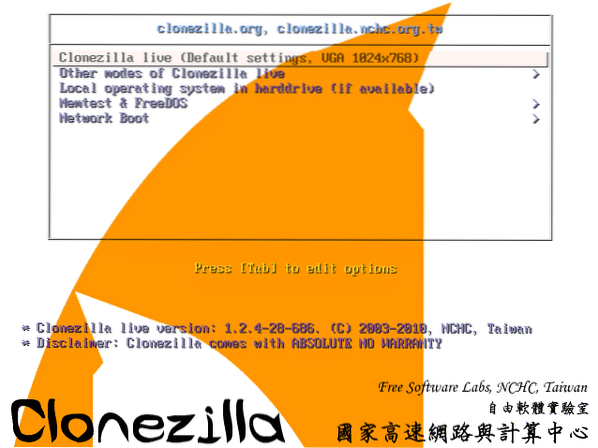

Til slutt har jeg to sikkerhetskopier til. En av disse er en (ekte) full systempartisjon til bildesikkerhetskopiering ved hjelp av en Clonezilla live USB. Clonezilla pakker en serie verktøy på lavt nivå for å replikere installasjoner. Og det andre er en fullstendig sikkerhetskopi av systemet som jeg laster opp til AWS S3 omtrent en gang i året når jeg har en stor dataopplasting til rådighet.

Alternativer for sikkerhetskopieringsverktøy

I disse dager er utvalget av verktøy du kan bruke stort.

Det inkluderer:

- Kjente CLI-er som rsync som kan skriptes og kalles som cron-jobb manuelt

- Programmer som Déjà Dup, Duplicity, Bacula som gir GUIer for å lage og automatisere sikkerhetskopiplaner til lokale eller off-site destinasjonsservere, inkludert de som drives av vanlige skyleverandører

- Og verktøy som grensesnitt med betalte skytjenester som CrashPlan, SpiderOak One og CloudBerry. Den siste kategorien inkluderer tjenester som gir billig skylagringsplass selv, slik at tilbudet er helt slutt.

3-2-1-regelen

Jeg skal gi en rask oversikt over verktøyene jeg bruker for øyeblikket på hovedmaskinen min.

Selv om jeg har skrevet noen Bash-skript for å få viktige konfigurasjonsfiler til hovedskylagringen min, som jeg bruker til daglige filer, sikkerhetskopierer denne (den essensielle) komponenten i sikkerhetskopieringsplanen min hele maskinen, inkludert virtuelle maskiner og system filer som bør utelates eller sikkerhetskopieres separat i mer nyanserte tilnærminger.

Dens sentrale forutsetning er overholdelse av 3-2-1-sikkerhetskopieregelen. Denne tilnærmingen skal holde dataene dine - inkludert ditt viktigste operativsystem - trygge i nesten ethvert feilscenario.

Regelen sier at du bør beholde:

- 3 kopier av dataene dine. Jeg sier alltid at dette er litt feilaktig fordi det faktisk betyr at du bør beholde den primære datakilden og to sikkerhetskopier. Jeg vil bare referere til dette som "to sikkerhetskopier"

- Disse to sikkerhetskopiene bør oppbevares på forskjellige lagringsmedier. La oss bringe dette tilbake til enkle hjemmebaserte vilkår. Du kan skrive et enkelt rsync-skript som (trinnvis) kopierer hoved-SSD-en din til et annet tilkoblet lagringsmedium - la oss si en HDD festet til neste SATA-port på hovedkortet. Men hva skjer hvis datamaskinen tar fyr eller huset blir ranet? Du vil bli stående uten din primære datakilde og ikke ha noen sikkerhetskopi. I stedet kan du sikkerhetskopiere den primære disken til en Network Attached Storage (NAS) eller bare bruke Clonezilla til å skrive den til en ekstern harddisk.

- En av de to sikkerhetskopiene skal lagres utenfor stedet. Sikkerhetskopiering utenfor stedet er viktig fordi i tilfelle en katastrofal naturlig hendelse som for eksempel flom, kan hele huset bli ødelagt. Mindre dramatisk kan en større overspenningsbegivenhet steke all tilkoblet elektronikk i et hus eller alle som er på en bestemt krets (det er derfor det er fornuftig å holde en av sikkerhetskopiene på stedet uten tilkobling til en strømforsyning - et eksempel er en enkel ekstern harddisk / SDD ).Teknisk sett er "offsite" hvor som helst som er et eksternt sted. Så du kan bruke Clonezilla til å skrive et bilde av operativsystemet eksternt til arbeids-PC-en din, eller en stasjon som er koblet til den, over internett. I disse dager er skylagring billig nok til rimelig å installere bilder med full stasjon. Av den grunn sikkerhetskopierer jeg systemet mitt, en gang i året, til en Amazon S3-bøtte. Å bruke AWS gir deg også massiv ekstra redundans.

Min sikkerhetskopieringsimplementering

Min tilnærming til sikkerhetskopier er basert på noen få enkle retningslinjer:

- Jeg vil ha ting så enkle som mulig;

- Jeg vil gi meg selv den mest overflødighet som jeg med rimelighet kan oppnå;

- Jeg vil i det minste følge 3-2-1-regelen

Så jeg gjør som følger.

- Jeg har en ekstra stasjon på skrivebordet som bare brukes til å huse Timehift gjenopprette poeng. Fordi jeg dedikerer en hel disk til den, har jeg ganske mye plass å leke med. Jeg tar en daglig, en månedlig og en ukentlig sikkerhetskopi. Så langt er Timeshift alt jeg trenger for å rulle systemet noen dager tilbake til et punkt før noe, som en ny pakke, hadde en negativ innvirkning på andre deler av systemet. Selv om du ikke kommer forbi GRUB, kan Timeshift brukes som en CLI med rotprivilegier for å reparere systemet. Det er et utrolig allsidig og nyttig verktøy. Dette er en første kopi på stedet.

- Jeg har en ekstra stasjon på skrivebordet mitt som bare brukes til å huse Clonezilla-bilder av hoveddisken min. Fordi disse bildene bare ville være nyttige for meg i tilfelle Timeshift mislyktes, tar jeg bare disse en gang hver tredje til seks måneder. Dette er en annen kopi på stedet.

- Ved hjelp av Clonezilla lager jeg en ekstra harddisk som jeg holder hjemme utenfor PCen. Bortsett fra at jeg for denne harddisken bruker en sikkerhetskopi av enhetsenheten i stedet for en sikkerhetskopi av enhetsbildet som i forrige bilde - slik at det ville være bra å gå øyeblikkelig hvis min primære stasjon ble muret. Hvis jeg for eksempel skulle komme meg fra den interne Clonezilla-sikkerhetskopidrevet, må jeg først følge en gjenopprettingsprosess. Forutsatt at de andre systemkomponentene er i god stand etter harddiskfeil, trenger jeg teoretisk bare å koble denne stasjonen til hovedkortet for å begynne å bruke den. Dette er en tredje kopi på stedet.

- Til slutt, hver sjette måned, laster jeg opp et Clonezilla-generert bilde av systemet mitt til AWS S3. Det er unødvendig å si at dette er en lang flerdelt opplasting og må utføres fra en internettforbindelse med en god opplastingslenke.

Alt i alt involverer systemet mitt tre eksemplarer på stedet og en kopi av stedet på hovedskjermbordet.

Hovedtaket

- Alle Linux-brukere bør ha robuste sikkerhetskopistrategier på plass

- 3-2-1-sikkerhetskopieregelen er en god målestokk for å sikre at dataene dine er trygge under nesten alle omstendigheter.

- Jeg bruker en kombinasjon av Timeshift og Cloudzilla for å lage sikkerhetskopier, selv om det er mange andre alternativer, inkludert betalte, på markedet. For skylagring bruker jeg en enkel AWS S3 bøtte, selv om det igjen er integrerte tjenester som inkluderer både programvare og lagringsverktøy.

Phenquestions

Phenquestions